文 | 魏启扬

来源 | 智能相对论(ID:aixdlun)

2020年的春节假期因为新冠疫情给所有人来了个措手不及,大量“云”服务被激活,作为在线沟通工具的输入法首当其冲,成为特殊时期接受考验的中坚力量之一,特别是语音输入能力,更是成为用户评价输入法是否好用的重要维度。

近日,百度输入法公布,自1月25日春节假期以来,百度输入法日均语音请求量突破10亿次大关,再创行业历史新高。

在很多人看来,这只不过一个数字而已,但很多年后,我们再来回首,日均10亿次的语音请求量或将成为推动输入法形态和操作方式变革的一个标志。

一、10亿次,必然是高流量和高标准的双重满足

回到百度输入法日均语音请求突破10亿次事件本身,我们需要回答两个问题,为什么会产生如此高的数据流量?完成这样的任务又需要具备哪些素质?

第一个问题很好回答,上文提到特殊时期各种“云”服务被激活,线上沟通需求呈指数级增加,输入法的使用频率由此被抬升,此时比传统键盘打字更快,还不用动手,更不用学习拼音、五笔这类输入规则的语音输入表现出非常大的优势,输入法语音请求量刷新历史记录也就不足为奇了。

只是在创造语音请求新纪录之前,输入法需要解决自己的流量承受能力,毕竟日均10亿次的请求流量不是一个小数字,好在经受过“春晚红包”考验的百度是见过“世面”的,甚至还有很大余地接下更大的流量压力。

第二个问题的核心关键在于输入法不但要能用、好用还需要用户喜欢用。

首先,在技术层面,准确率是无法绕开的基础门槛。

作为一种输入方式,让用户愿意使用,首要满足条件是准确率,即精准理解用户的意图并将其表达出来。

键盘打字输入能够成为主流输入方式,很大原因在于用户的一字一句被完全复刻,输入结果精准且高效。

相比之下,语音输入需要经过机器“识别”到“翻译”再到呈现的过程,输入链条被拉长,如果技术不够完善,不但不能完成实时语音交互任务,而且只要其中任何一个环节出现问题,都会影响到最终的输入结果,准确度难以保证。

百度去年发布的流式截断多层注意力建模(SMLTA),则实现了中文在线语音识别的两大突破:世界上首次实现了局部注意力建模识别精度超过全局注意力模型;世界上第一次大规模部署在线语音交互注意力模型。

也正是凭借着这一技术,百度解决了传统Attention模型在识别中的时延性,以及因此导致的无法进行大规模在线语音实时交互的问题,将百度输入法在线语音识别精度提升了15%,超越行业最高水平15%。同时在离线语音识别方面,即使用户处于地铁、电梯、隧道或者人流密集等离线场景中,百度输入法依然可以提供准确率超过98%的语音输入服务。

其次,在用户层面,“懂你”比“给你”更重要。

准确率是满足用户需求的基础门槛,但这也只是解决了“能用”的问题,要想让用户爱用,并形成使用习惯,那就要求输入法要“懂”用户。

如何理解?

说话时口语化怎么办?说话习惯中英夹杂怎么办?说话有方言口音又怎么办?这些情况下,输入法都能识别清楚吗?

很明显这类说话习惯一旦养成,在短时间内既难纠正,更难改变,特别是一些年长用户,让他们改变几十年来形成的口音,基本是一个不能完成任务,这时就要求输入法不能只是被动的向用户提供自己的输入能力,而要主动“迁就”用户,“听懂”用户的意图。

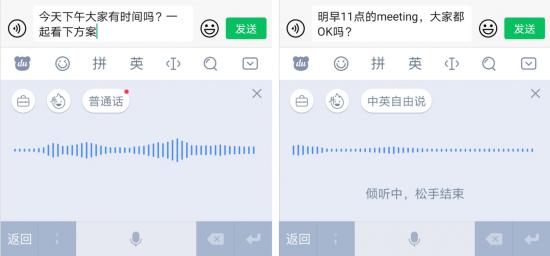

百度输入法的“方言自由说”和“中英自由说”两大功能就是这一产品设计思维下的产物。

前者是通过技术优化,将普通话和六大方言融合成了一个语音识别模型,实现方言与方言、方言与普通话的混合语音输入,这也使百度输入法成为首个实现方言免切换语音输入的输入法产品。

后者可以在完全不影响中文语音输入准确率的情况下,实现高精准中英文混合语音识别输入。

在去年的百度AI开发者大会上,百度输入法面对了一段高难度“Rap”识别挑战:“你的这个新model效果比baseline好多少,探索技术的depth和scope是我们的责任,我很喜欢barrier这个词,AI的value其实就是break barrier”。

这段中英混杂的文字,即便读出来也需在脑中回旋许久才能领会意思,但百度输入法在现场却零误差的识别出来了,不但准确理解还根据语义进行了正确断句,并且以非常快的速度上屏呈现结果。

最后,在创新层面,总能给用户带来惊喜。

上文提到的无论是流式截断多层注意力建模(SMLTA),还是“方言自由说”和“中英自由说”两大功能,都是百度输入法的创新成果。很明显,因为创新给用户带来体验提升的同时,也带来了愉悦与惊喜,并因此完成了用户的拉新与留存。

偶然使用过百度输入法用户,体验过创新功能后,由路转粉;百度输入法的老用户,在经历了输入法的持续迭代进化,一直处于对下一次创新功能的期待中,进而成为铁粉。

目前我们看到的百度输入法呈现在外好像只是单纯的声音到文字的转换,但事实上,百度输入法已经成为软硬一体、语音语言一体,识别和交互一体的复杂应用。

综上而言,达成10亿次成就,除了有深厚的技术实力作为支撑和保障,还需有技术温度,带来“人情”,感知“冷暖”。

二、打开AI的魔盒,我们到底需要怎样的输入法?

我们注意到,随着AI开始进入工业大生产阶段,输入法的形态和模式也开始发生变化,从键盘打字输入到语音输入,我们看到的只是其中的一个表象,在AI的驱动下,输入法正由内向外在更多维度发生着变化。

在讨论输入法形态变化之前,我们需要理解输入法进化的原因。

首先,用户需求和场景倒逼,键盘打字输入已经out了。

在互联网时代,输入法只出现在PC端,使用场景单一,输入法厂商只需保证输入结果的准确和快捷即可具备较强的竞争力。

进入移动互联网时代,用户使用的智能终端变多,使用场景也更加丰富起来,这就要求输入法不光要适用不同终端的使用习惯,还需适应不同场景的使用需求,因而在操作方式上不再局限于键盘打字输入,语音输入方式成为一个非常重要的能力被提炼出来。

像此次疫情,语音输入方式除了场景倒逼之外,用户希望更快、更便捷的输入体验升级,也推动着传统输入法做出改变。

可以预测,当我们进入物联网时代后,还会有更多的输入方式出现。

其次,拥有AI内核的输入法变得无处不在无所不能。

输入法自身也一直在寻求进化迭代,只是我们所说的输入技术并非只局限于提高输入法准确性的基础能力,而是通过AI技术的赋能,创新输入法产品形式,让用户获得更好的使用体验。

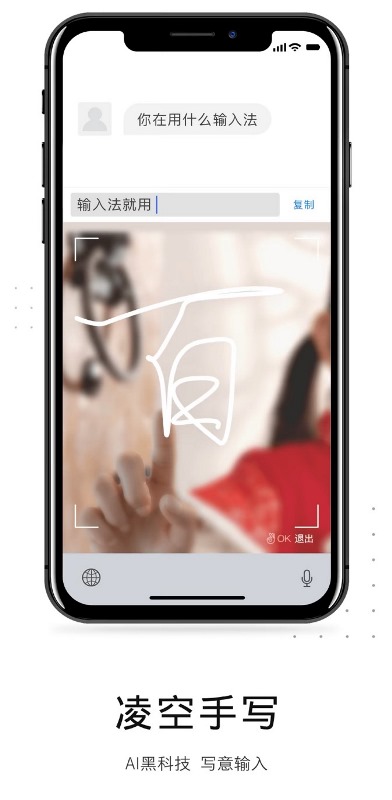

像百度输入法基于NLP、图像识别、AR等技术,推出了NLP整句预测、AI斗图、神句配图、皮肤主体C位识别等功能,成为业内首家实现多场景整句智能预测的输入法产品;去年发布的AI探索版,还创新性的推出全语音交互的产品新形态和凌空手写等领先的AI功能。

用户需求和使用场景的变化,任何一个输入法产品都能掌握,但能否根据这些变化做出应对,则非常考验产品在“输入”之外的能力。一为行业进化趋势的洞察力,一为支持产品迭代的技术储备力。

三、踏上10亿次台阶,百度开启输入法的生态空间

每天10亿次语音请求交互是一个里程,也是一个台阶,一个迈向输入法下个形态高度的台阶。对于百度输入法来说,这个创造纪录的数据则为其开启生态空间的打法提供了基础。

第一是用户基础。

在此之前,根据艾媒咨询不久前发布的《2019中国第三方手机输入法市场年度专题研究报告》显示,百度输入法去年全年月活增速处于行业第一,市场份额达43.1%,与搜狗几近持平。

今年春节期间的语音请求交互流量的爆发,百度输入法在完成了对用户语音输入普及和教育的同时,也因新型输入方式带来的体验升级进一步提升了用户的粘性。

第二是内容基础。

当用户的基数足够大的时候,为满足用户的个性需求,输入法的内容承载形式也出现了创新。

百度输入法不但与Cherry、FILCO、ROG等近20家外设头部品牌建立了输入法行业的独家内容生态联盟,与这些外设品牌共同推出旗舰仿真键盘精品授权皮肤,还与Cherry合作打造仿真键盘,在华为Mate30 pro上高度还原Cherry实体机械键盘轴的触感。

可盐可甜,输入内容的丰富既是用户体验的升级,亦是产品技术的升级。

第三是硬件厂商的合作基础。

百度输入法庞大的用户基础,也将顺理成章的打通硬件厂商的预装渠道,成为更多硬件终端的预装应用。

事实上,百度输入法长期以来都是华为的预装合作输入法,二者在机型适配、输入体验的打造上已经形成默契,很明显,两者的合作形成了双赢的结局,这也给其他硬件厂商树立了一个可以参照的典范。

可以想象,当百度输入法进入越来越多的硬件终端时,结合其巨大的用户基础和丰富内容,将构建起一个充满活力的输入法生态。

由生态对抗单一的输入法应用,你可以将其理解为“抢跑”,也可理解为“降维”竞争,在输入法的战略布局上,百度又走在了前面。

此内容为【智能相对论】原创,

仅代表个人观点,未经授权,任何人不得以任何方式使用,包括转载、摘编、复制或建立镜像。

部分图片来自网络,且未核实版权归属,不作为商业用途,如有侵犯,请作者与我们联系。

智能相对论(微信ID:aixdlun):

•AI新媒体;

•今日头条青云计划获奖者TOP10;

•澎湃新闻科技榜单月度top5;

•文章长期“霸占”钛媒体热门文章排行榜TOP10;

•著有《人工智能 十万个为什么》

•【重点关注领域】智能驾驶、AI+医疗、机器人、AI+硬件(含无人机、智能手机、电视)、物联网、AI+金融、AI+教育、AR/VR、云计算、开发者以及背后的芯片、算法等。